Intel Dizüstünüz Artık LLM Çalıştırıyor — NVIDIA'ya Gerek Yok [Kıyaslamalar]

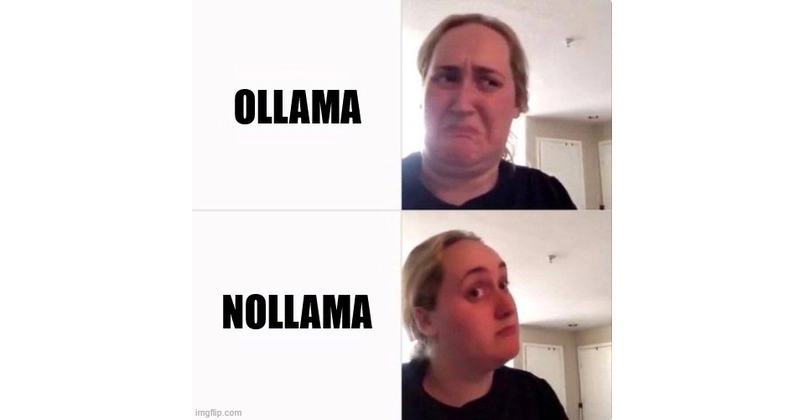

Herkes LLM'lerin NVIDIA GPU'su ya da bulut sunucusu şart dedi. NoLlama oyunu tersine çevirdi — Intel dizüstünüzün NPU'su yerel AI canavarı oldu, sohbet ve görüntü modellerini akıcı akıcı çalıştırıyor.

⚡ Key Takeaways

- NoLlama Intel NPU, iGPU, ayrı GPU ve CPU'da LLM'leri sorunsuz çalıştırıyor — konfigürasyon derdi yok. 𝕏

- Donanımı otomatik buluyor, OpenAI/Ollama API'lerini destekliyor, sohbet ve görüntü modellerini yerel akışla. 𝕏

- Hassas veriler için ideal (GDPR, tıbbi, hukuki) — bulut sızıntısı sıfır, denetim geçirmez. 𝕏

- Kıyaslamalar: NPU 8B'de ~5 tok/s, iGPU VLM'lerde 15-20 tok/s; verim ham hızı ezer. 𝕏

- Akıllı telefon ARM devrimi gibi NPU kayması öngörüyor — 2026'ya kenar AI ana akım. 𝕏

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to