인텔 노트북으로 LLM 돌린다—no NVIDIA 필요 [벤치마크]

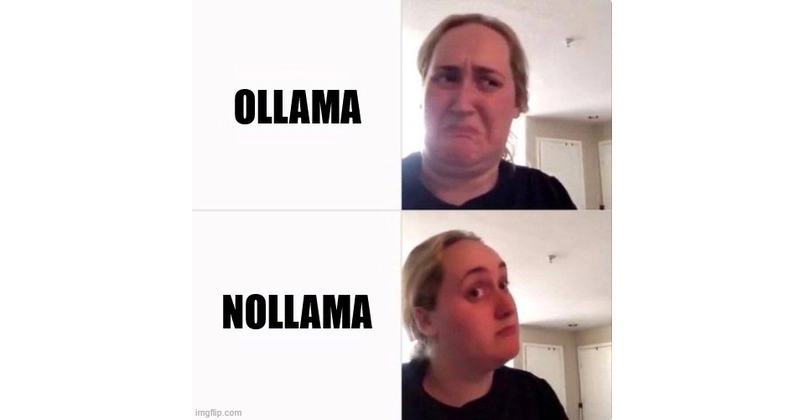

모두 LLM은 NVIDIA GPU나 클라우드 서버 없인 안 된다고 생각했다. NoLlama가 판을 뒤집었다—인텔 노트북 NPU가 로컬 AI 괴물로 변신, 채팅과 비전 모델도 거뜬히 스트리밍.

⚡ Key Takeaways

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to