IntelノートPCでLLMが動く時代——NVIDIA不要【ベンチマーク】

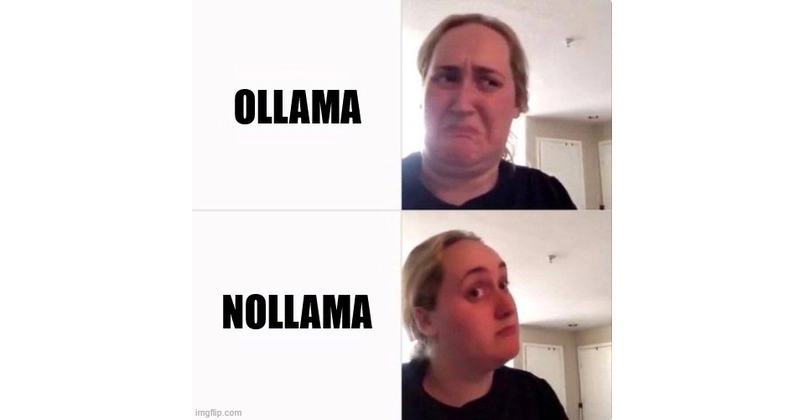

LLMはNVIDIAのGPUかクラウドサーバーが必須だと思われていた。NoLlamaがそれを覆す——IntelノートPCのNPUがローカルAIの怪物に変身、チャットやビジョンモデルをサクサクストリーミングだ。

⚡ Key Takeaways

Worth sharing?

Get the best Open Source stories of the week in your inbox — no noise, no spam.

Originally reported by Dev.to