Знаете, я повидал немало циклов в Кремниевой долине, и, признаться, больше, чем хотелось бы. Видел, как модные тренды возникают и исчезают, как компании взлетают, а потом растворяются в эфире, потому что, сюрприз, у них не было реальной бизнес-модели. Поэтому, когда я вижу статью под заголовком «TurboQuant: пошаговое руководство от первых принципов», мой детектор лжи зашкаливает. Недостаточно просто бросаться терминами вроде «векторы» и «квантизация», чтобы меня впечатлить. Мне нужно знать, почему это важно и, что еще более важно, кто здесь на самом деле зарабатывает деньги. Поможет ли это какому-нибудь стартапу привлечь очередной раунд венчурного финансирования, или это то, что действительно изменит правила игры для разработчиков и пользователей?

Кто что «хавает»?

Перейдем к сути. По сути, речь идет о том, чтобы взять большой, громоздкий кусок данных — представьте себе эти массивные эмбеддинги, которые выдает ваша любимая модель ИИ — и сжать его так, чтобы его было проще хранить и обрабатывать. В оригинальной статье векторы описываются как «стрелки из начала координат», а «ошибка — это расстояние между предположением и истиной». Всё хорошо. Милые диаграммы 2D и 3D сеток, привязывающих точки, конечно. Это как цифровое Лего. Но вот в чем загвоздка: когда мы говорим об этом в контексте ИИ, мы часто имеем в виду уменьшение моделей, чтобы они могли работать на вашем телефоне, или передачу меньшего объема данных по сети, или ускорение этих мучительно медленных поисков ближайших соседей. Именно здесь обычно кроются деньги — повышения эффективности, которые трансформируются в снижение расходов на облако или новые категории продуктов.

Сама статья излагает несколько фундаментальных концепций: среднеквадратичную ошибку (MSE) для измерения того, насколько далеко от истины ваше предположение, моменты величины (по сути, статистические отпечатки пальцев) и идею несмещенной оценки, которая означает, что ваш метод угадывания в среднем попадает в цель. Это много математики, которая сводится к тому, чтобы убедиться, что ваши сжатые данные являются достаточно точным представлением оригинала.

Ошибка — это расстояние между предположением и истиной. Оценка предположения по знаку ошибки позволяет положительным и отрицательным ошибкам взаимно уничтожаться, что означает, что оценка не наказывает за отклонение. Возведение в квадрат заставляет каждую ошибку считаться положительным числом и наказывает большие ошибки сильнее, чем маленькие.

Та самая часть с возведением в квадрат? Это то, что заставляет их особенно сильно переживать из-за больших ошибок. А в ИИ большие ошибки могут означать что угодно: от чат-бота, несущего чушь, до рекомендательного движка, показывающего вам кошачьи свитера, хотя вы искали только корм для собак. Так что минимизация этой квадратичной ошибки, знаете ли, это хорошо. Это разница между тем, помнит ли ваш ИИ то, что должен, или просто… забывает все важное.

Компромисс между смещением и разбросом, или просто еще больше модных словечек?

Затем перейдем к оценкам. Смещение (bias) и разброс (variance). Представьте себе стрельбу из лука. Смещение — это когда ваши стрелы постоянно попадают на десять футов левее центра мишени, даже если они все скучены вместе. Разброс — это когда ваши стрелы разбросаны по всей мишени, но их среднее положение приходится на центр. В большинстве случаев эти компании пытаются снизить оба показателя. В статье упоминается «центр мишени», иллюстрирующий эти режимы отказа. Отлично. Но опять же, кто от этого выигрывает? Если TurboQuant действительно сокращает смещение и разброс в этих векторных представлениях, это означает, что ваши модели ИИ станут более точными и последовательными. Это, безусловно, победа для разработчиков моделей. Но реальная выгода? Она заключается в том, когда эта улучшенная точность и последовательность транслируются в лучший пользовательский опыт, за который люди готовы платить, или когда повышение эффективности позволяет компаниям запускать более крупные и сложные модели с меньшими затратами.

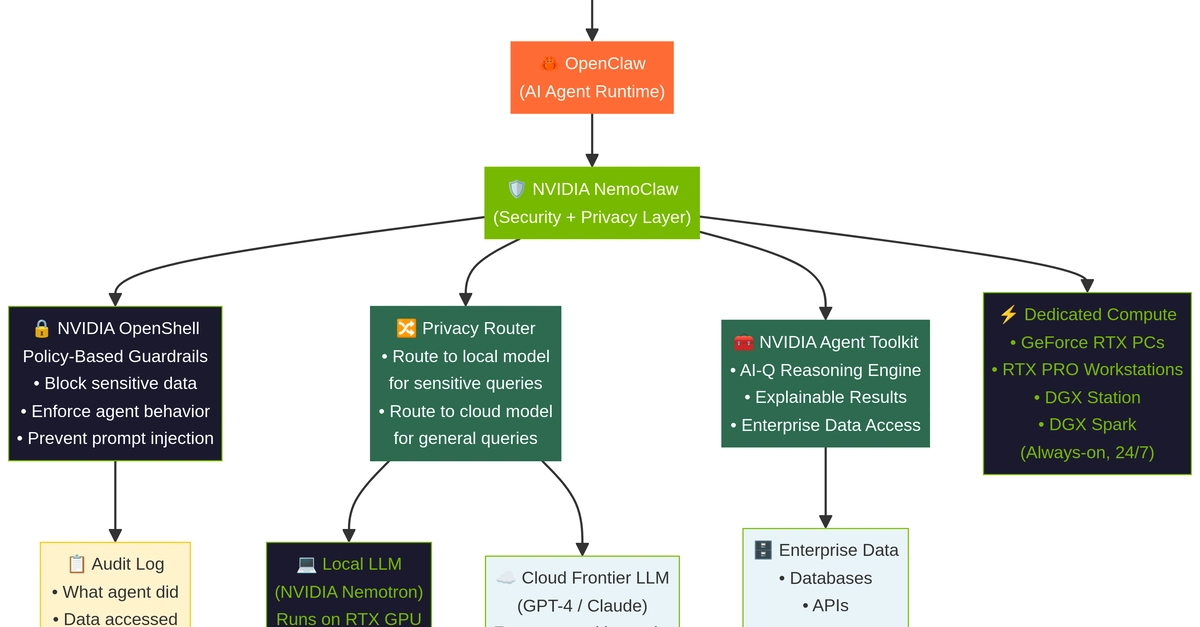

Мое чутье подсказывает, что это направлено на то, чтобы сделать модели ИИ меньше, быстрее и дешевле в эксплуатации. Подумайте об ИИ на устройстве или ИИ, для которого не нужен суперкомпьютер у вас в подвале. Вот где настоящая проверка реальности для многих бизнесов.

Это просто высокоразмерный жаргон?

Что действительно привлекает мой циничный взгляд, так это упоминание «высокоразмерной концентрации». Простыми словами, это означает, что в условиях сверхвысоких размерностей (например, 1536 измерений для эмбеддинга OpenAI, упомянутого в статье) вещи становятся странными. Точки, которые должны быть близко, могут оказаться далеко друг от друга, и наоборот. Именно здесь стандартная интуиция подводит. Квантизация, процесс привязки этих высокоразмерных векторов к ограниченному набору «уровней» или точек, может представлять собой настоящую проблему. Если ваш метод квантизации не учитывает эту высокоразмерную странность, вы можете получить сжатое представление, которое практически бесполезно.

В статье предполагается, что TurboQuant находит способы справиться с этим. Но остается вопрос: предлагает ли он значительное улучшение по сравнению с существующими методами? Достаточны ли приросты, чтобы оправдать усилия по интеграции новой техники, или это просто очередной инкрементальный шаг, выданный за нечто большее? Мы уже видели, как это происходит с новыми алгоритмами сжатия, которые обещают золотые горы, а доставляют лишь немного более плавную поездку. Настоящее испытание — не элегантность статьи, а реальная производительность и экономический стимул к ее внедрению.

С моей колокольни, наблюдая за тем, как технологическая индустрия с головокружительной скоростью производит инновации (и питчи для инвесторов), TurboQuant выглядит как технически интересная работа. Он решает реальную проблему: делает данные ИИ более управляемыми. Но «от первых принципов» и «пошаговое руководство» также могут быть кодом для «глубоко академично, еще не готово к производству». Пока я не увижу, что это появится в реальных развернутых системах, снизит затраты или позволит использовать совершенно новые приложения ИИ, которые раньше были невозможны, я буду оставаться осторожно скептичным. Главный вопрос не в том, «насколько умна математика?», а в том, «сколько денег это приносит кому-то, где-то?» И это, друзья мои, самый старый вопрос в Кремниевой долине.