Надежды, связанные с генерацией изображений с помощью ИИ, не увязли ли в разочаровывающей паутине облачных подписок, непрозрачных систем кредитов и фильтров контента, которые, кажется, живут своей жизнью? Это типичное узкое место, особенно когда вам нужен контроль, конфиденциальность или просто хочется избежать постоянных расходов, связанных с генерацией пикселей на удаленных серверах.

Сейчас на горизонте появился важный инструмент, обещающий распутать этот узел. Docker Model Runner в связке с Open WebUI обеспечивает полностью локальный, ориентированный на конфиденциальность конвейер для генерации изображений. Это не просто теоретическая возможность; это практичное, реализуемое решение, которое полностью обходит облачные зависимости, предлагая убедительную альтернативу как частным лицам, так и разработчикам.

Привлекательность локального контроля

Запуск моделей генерации изображений локально — не новая концепция, но простота интеграции и отточенный пользовательский опыт, предлагаемые этим решением на базе Docker, являются заметным шагом вперед. Традиционно настройка локального инференса для таких сложных моделей, как Stable Diffusion, означала борьбу с Python-окружениями, ад зависимостей и зачастую серьезные трудности с конфигурацией GPU. Предлагаемый подход значительно упрощает этот процесс.

Используя контейнеризацию Docker, сложные зависимости и среды выполнения как для механизма инференса, так и для пользовательского интерфейса аккуратно упаковываются и управляются. Это означает, что вы получаете не просто инструмент командной строки, а полноценное приложение для генерации изображений с помощью ИИ, работающее полностью офлайн.

Как это на самом деле работает: Технический разбор

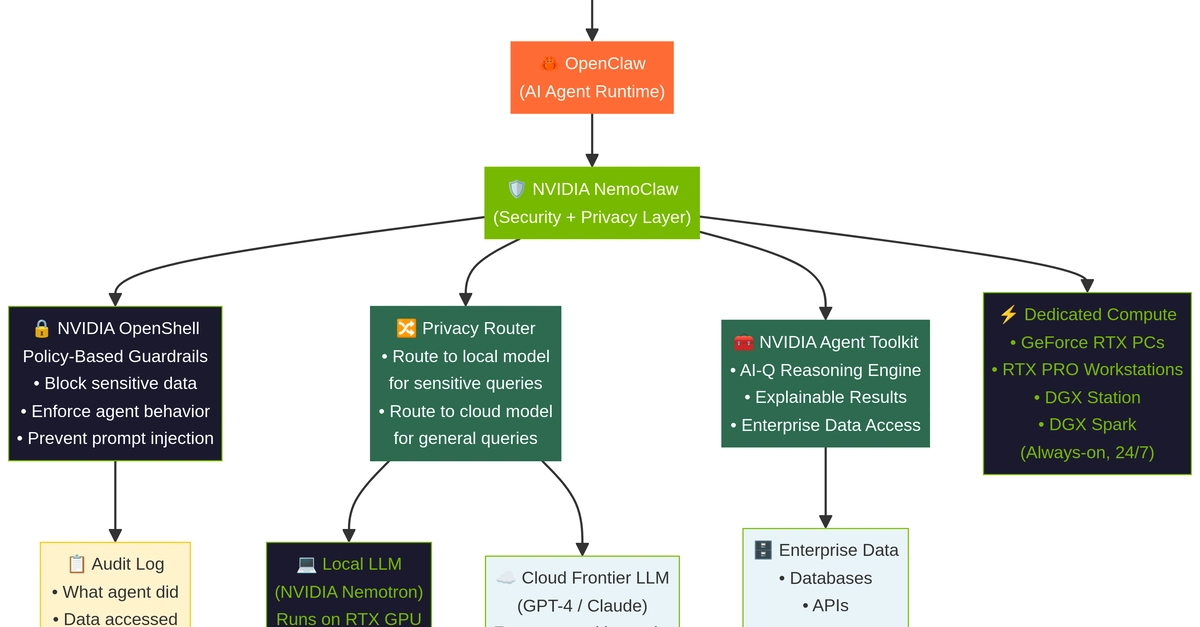

По своей сути Docker Model Runner выступает в роли сложного оркестратора. Он берет на себя основную работу по загрузке моделей ИИ — которые он упаковывает в формат DDUF (Diffusers Unified Format) — и управляет их жизненным циклом инференса. Ключевое нововведение — его способность предоставлять 100% совместимый с OpenAI API. Это критически важно, поскольку Open WebUI, популярный чат-интерфейс для LLM, уже умеет работать с этим форматом.

Представьте себе это так: Docker Model Runner — это переводчик и машинное отделение. Он загружает модель Stable Diffusion (или другие), гарантирует её готовность к вычислениям, а затем представляет свои возможности через API, который Open WebUI может понять без каких-либо специальных слоев трансляции. Это хитрое архитектурное решение обеспечивает такую плавную интеграцию.

Шаг 1: Загрузка модели домой

Загрузка модели генерации изображений на вашу локальную систему удивительно проста. Одна команда docker model pull скачивает необходимые компоненты. Модель stable-diffusion, например, доступна сразу.

docker model pull stable-diffusion

Эта команда загружает артефакт модели, который затем сохраняется локально. Вы можете изучить его детали, подтвердив размер и формат, обычно это файл DDUF, содержащий все необходимые веса модели и конфигурации.

docker model inspect stable-diffusion

Это отображает чистое представление модели — её ID, теги, время создания и, что критически важно, формат и размер. Сам формат DDUF разработан для переносимости, по сути, объединяя компоненты диффузионной модели в один управляемый файл. Docker Model Runner знает, как его распаковать и использовать.

Шаг 2: Запуск интерфейса

Вот где происходит настоящее волшебство. Docker Model Runner включает команду launch, специально разработанную для Open WebUI. Выполнение docker model launch openwebui запускает необходимые контейнеры, настраивает сеть и делает WebUI доступным через ваш браузер.

docker model launch openwebui

“Под капотом” эта команда оркеструет команду docker run. Она сопоставляет порт UI (3000) с хостом и, что важно, устанавливает переменные окружения, такие как OPENAI_API_BASE и OPENAI_BASE_URL, указывающие на специальное внутреннее имя хоста Docker (model-runner.docker.internal). Это имя хоста позволяет контейнерам общаться со службой Model Runner, работающей на хост-машине, без сложного проброса портов.

Если вы предпочитаете держать WebUI запущенным в фоновом режиме, флаг --detach — ваш лучший друг. Для тех, кто предпочитает управлять своими службами через конфигурационные файлы, также доступен набор Docker Compose, предлагающий более декларативный подход.

Шаг 3: Настройка генерации изображений в Open WebUI

После запуска Open WebUI и создания локальной учетной записи (будьте уверены, все данные остаются офлайн), достаточно быстрого перехода в настройки администратора, чтобы включить генерацию изображений. Перейдя по адресу /admin/settings/images, вы увидите простую форму.

Здесь вы включаете функцию и указываете конечную точку API модели. Вы введете stable-diffusion в качестве имени модели и http://model-runner.docker.internal/engines/diffusers/v1 в качестве URL API. UI также потребует фиктивный API-ключ, но поскольку для локальной службы аутентификация не требуется, подойдет любая непустая строка.

Шаг 4: Добавление текстового интеллекта

Open WebUI — это не просто интерфейс для изображений; это полноценный чат-интерфейс, и его способность генерировать изображения на основе диалоговых промптов является значимой функцией. Для этого вам также понадобится локально запущенная языковая модель (LLM). Docker Model Runner поддерживает загрузку различных LLM, таких как smollm2 для систем с ограниченными ресурсами или gpt-oss для более мощных машин и тонкого творческого вывода.

# Легкий вариант — работает почти на любой машине

docker model pull smollm2

# Рекомендуемый — более мощный, лучше понимает творческие промпты

docker model pull gpt-oss

Эти модели автоматически появляются в селекторе моделей Open WebUI, позволяя вам плавно переключаться между ними. Затем LLM использует настроенную конечную точку генерации изображений для выполнения запросов в чате.

Динамика рынка: Почему это важно

Это не просто техническое удобство; это реальный сдвиг в том, как частные лица и небольшие организации могут получить доступ к мощным возможностям ИИ. Годами нарратив доминировали крупные облачные провайдеры и их проприетарные API. Хотя это удобно, такая модель создает значительные барьеры, связанные со стоимостью, конфиденциальностью данных и привязкой к поставщику. Повышение сложности локального оборудования в сочетании с достижениями в оптимизации моделей и контейнеризации наконец-то демократизируют эти продвинутые инструменты.

Рассмотрим последствия для независимых художников, исследователей и разработчиков. Теперь они могут экспериментировать, итерировать и развертывать контент, сгенерированный ИИ, без постоянного беспокойства о растущих счетах за облачные услуги. Аспект конфиденциальности столь же привлекателен; конфиденциальные проектные данные или личные творческие работы никогда не покидают машину пользователя. Этот самосуверенитет над инструментами ИИ является мощным контрнарративом централизованной облачной парадигме.

Мой уникальный взгляд на это: В то время как многие расхваливают локальный ИИ за экономию средств, настоящая революция заключается в автономном творчестве и НИОКР. Для сценариев, где подключение к Интернету ненадежно или действуют строгие законы о месте хранения данных, этот подход становится не просто предпочтительным, а необходимым. Это разница между инструментом, который работает, когда интернет включен, и тем, который работает, когда он нужен вам.

Действительно ли это лучше облачных сервисов?

Для многих сценариев использования — да. Основные преимущества очевидны: отсутствие регулярных платежей, полная конфиденциальность данных и возможность работы даже в автономном режиме. Компенсация? Вам понадобится адекватное локальное оборудование, в частности, производительный GPU, чтобы добиться быстрой генерации. Если ваши потребности эпизодичны или экспериментальны, порог входа может показаться выше, чем простая регистрация в облаке. Однако при постоянном использовании, профессиональных рабочих процессах или в любых ситуациях, требующих строгого контроля над данными, локальное решение Docker Model Runner и Open WebUI является убедительным предложением. Оно превращает генерацию изображений с помощью ИИ из потребляемой услуги в инструмент, которым вы управляете.

Почему это важно для разработчиков?

Разработчики получают песочницу для экспериментов без дополнительных затрат на облако. Они могут интегрировать генерацию изображений с помощью ИИ в локальные рабочие процессы разработки, тестировать новые методы промпт-инжиниринга и создавать приложения, использующие эти модели, не полагаясь на внешние API. API, совместимый с OpenAI, является значительным преимуществом, упрощая интеграцию с существующими инструментами и фреймворками, которые уже поддерживают экосистему OpenAI. Это снижает барьер для создания сложных функций на базе ИИ непосредственно на машине разработчика.

🧬 Связанные аналитические материалы

- Читайте также: Разработчик Scrapy обрушился на AI-скрейперы: код — пустяк, страницы сопротивляются

- Читайте также: HIPAA 2026: шифрование обязательно, гибкость для больниц мертва

Часто задаваемые вопросы

Что конкретно делает Docker Model Runner? Docker Model Runner управляет загрузкой и жизненным циклом моделей ИИ, предоставляя их через API, совместимый с OpenAI, для использования такими же совместимыми приложениями, как Open WebUI. Он обеспечивает локальный, офлайн-инференс ИИ.

Заменит ли это мои облачные подписки на генерацию изображений? Для многих пользователей, особенно тех, кто ценит стоимость, конфиденциальность или возможность работы в автономном режиме, — да. Однако облачные сервисы могут по-прежнему предлагать удобство, более высокую масштабируемость или доступ к передовым моделям, которые еще не доступны для локального развертывания.

Сколько ОЗУ мне нужно для локальной генерации изображений с помощью ИИ? Рекомендуется около 8 ГБ ОЗУ для небольших моделей, но чем больше, тем лучше, особенно для более крупных и мощных моделей. Выделенный GPU значительно улучшает производительность.