生成AIモデルを運用する組織の3分の2が、推論にKubernetesを利用している。本番環境でのKubernetes導入率は82%だ。CNCFとSlashDataが共同で行った調査の2026年第1四半期最新データが、KubeCon + CloudNativeCon Amsterdamで発表され、業界が以前から感じていたことを具体的な数字で示した。KubernetesはAIの波を乗り越えているだけでなく、まさにその波が走るプラットフォームなのだ。

「KubernetesはAIのデファクトOSになりつつある」

これは誇張ではない。CNCFのシニアテクニカルプログラムマネージャー、Bob Killen氏がKubeConの展示会場で語った言葉だ。この業界で20年もいると、こうした断言には歯を食いしばりたくなることもあるが、今回のデータは…反論するのが難しい。

CNCFの調査では、クラウドネイティブ開発者コミュニティは世界で1990万人に達することも明らかになった。特に注目すべき点は以下の通りだ。

- 組織の82%が本番環境でKubernetesを運用している。マジで、まだ仮想マシンでどうにかしようとしているなら、時代遅れもいいところだ。

- Gen AIを運用する組織の3分の2が、推論にKubernetesを利用している。これは最新モデルを選ぶ話ではない。配管(インフラ)の話だ。

- インフラと開発の間の、しばしば無視されがちな中間層であるオペレーターの経験が、ついに最重要課題となった。よし。

- 真のボトルネックはコード生成ではない。それはDevOps、信頼性、そしてセキュリティだ。驚きはないだろ。

コーディングが長引く要因になることなど、元々なかった。AI生成コードは、ただでさえ短いポールをさらに短くしただけだ。セキュリティ、信頼性、運用規律はすでに手一杯だった。それが今、人間が生成せず、必ずしも理解できないコードの量でさらに追い詰められている。まるで幼児に家を建てる魔法の杖を与えたようなものだ。彼らは数秒で何かをこしらえられるが、5分後には構造エンジニアを呼ばなければならなくなるだろう。

CNCFのデータはこれを明確に示している。ガードレールこそが、組織が炎上させることなく速く動けるようにするメカニズムなのだ。SlashDataのプリンシパルマーケットリサーチコンサルタント、Liam Bollmann-Dodd氏はこう簡潔に述べた。

非常に有能であれ、中程度であれ、スキルアップした、あるいはスキルダウンしたAI開発者であっても、基本的に我々のシステムを破壊できない、彼らの行動は制限されている、と言える。だから、多少危険な行動を許容できる。なぜなら、彼らは実際には何も壊せないのだから。

そして、それが核心だ。意味するところは直接的だ。ジュニア開発者にとって良いことは、AI開発者にとっても良いのだ。適切なガードレールを備えた内部開発者プラットフォームこそが、真の解禁キーであり、モデルを切り替えることではない。それは純粋な無秩序ではなく、管理されたカオスなのだ。誰が恩恵を受けるか?プラットフォームエンジニアはもちろん、システムを稼働させ続けたいと願う誰もがそうだ。

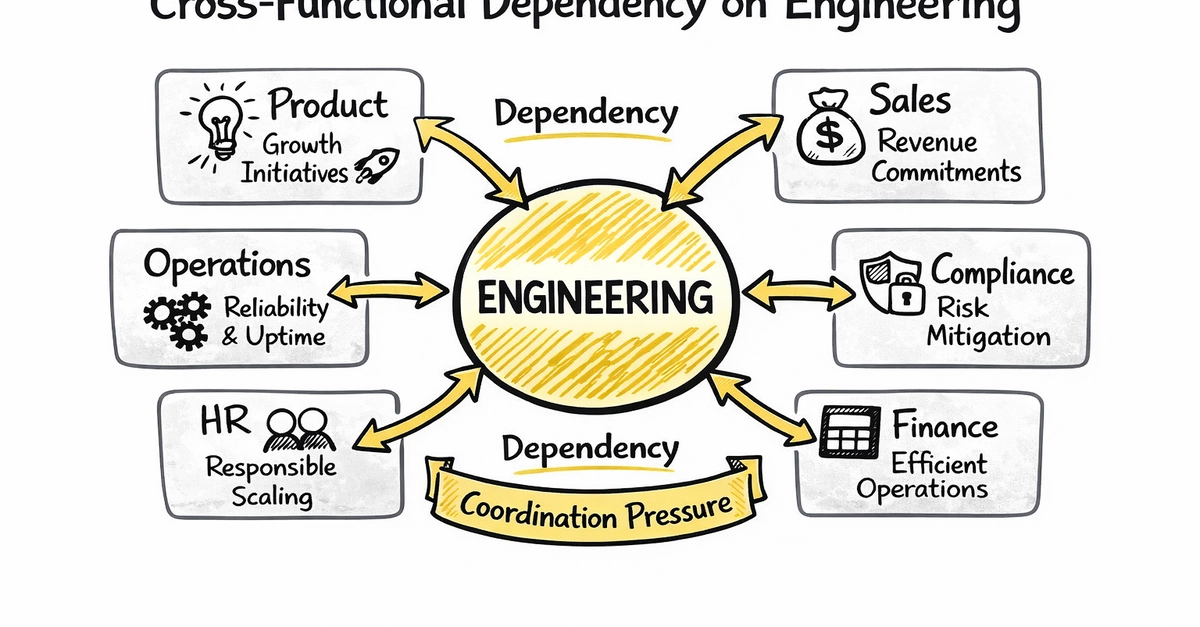

データはまた、チームの組織構造の変化も示している。Killen氏は、小規模なクロスファンクショナルなDevOpsチームから、より大規模な専任プラットフォームエンジニアリンググループへの移行と表現した。

「今、私たちはその変化を見ている。プラットフォームエンジニアリングに注力し、内部チームが活用できるサービスを提供する、より大規模なチームが、社内チームを支援している。」

これはTeam Topologiesモデルが標準的なプラクティスになりつつあることと一致する。プラットフォームチームは内部サービスプロバイダーとして、AIエージェントを含む他のすべての人々の認知負荷を軽減する。率直に言って、これは賢明な進化だ。すべてのプロジェクトでデプロイやオブザーバビリティの車輪を再発明するのはやめよう。堅牢なプラットフォームを構築し、アプリケーションチームには彼らの仕事に集中させるのだ。

では、あなたにとってこれは何を意味するのか?

ベアメタルインフラやVMでAIを運用しているか?データはKubernetesへの統合を支持している。コミュニティ、ツール、エコシステムは揃っている。時代に乗り遅れるな。Gen AI推論をスケールさせたいか?Kubeflowと、より広範なCNCFのAI/MLランドスケープに目を向けよう。コミュニティの投資はそこに集まっている。AI生成コードに埋もれているか?さらにAIツールを追加する前に、内部開発者プラットフォームとガードレールを優先しよう。ボトルネックは生成ではない。プラットフォームエンジニアリング機能を構築しているか?フルスタックDevOpsのジェネラリストからプラットフォームスペシャリストへの移行が確認された。それに応じて人材を配置せよ。それは専門化の話であり、率直に言って、とっくにそうなるべきだったのだ。

アムステルダムからのメッセージは明確だ。AIをスケールさせるのは、オープンインフラ、コミュニティ主導のツール、そしてエンジニアリング規律である。モデル自体はほとんど問題ではない。そして、技術サイクルが来て去るのを見てきた我々にとって、これは革命というよりは、堅実で、たとえ避けられなかったとしても、ベストプラクティスの集約のように感じられる。お金は、いつものように、複雑なものをシンプルにし、信頼できないものを信頼できるようにするものに流れる。

🧬 関連インサイト

よくある質問

KubernetesはAIに具体的に何をするのか? Kubernetesは、特に推論において、AIモデルのデプロイと実行のための安定した、スケーラブルで管理可能な環境を提供する。自動スケーリング、セルフヒーリング、リソース割り当てなどのタスクを処理し、複雑なAIワークロードの管理を容易にする。

これは私の仕事を代替するのか? 可能性は低い。AIツールはコーディングなどのタスクを自動化できるが、これらのAIモデルが実行されるインフラ(Kubernetesなど)を構築、管理、保護するためのスキルのあるエンジニアの需要は増加している。プラットフォームエンジニアリング、セキュリティ、信頼性に関するスキルに焦点を当てよう。

Kubernetesは小規模チームには複雑すぎないか? Kubernetesには学習曲線があるが、ツールとマネージドサービスの成長するエコシステム、そして内部開発者プラットフォームへのトレンドは、その複雑さの多くを抽象化することを目指している。データによれば、小規模な組織でさえ、特にAIワークロードを実行する際には採用していることが示唆されている。